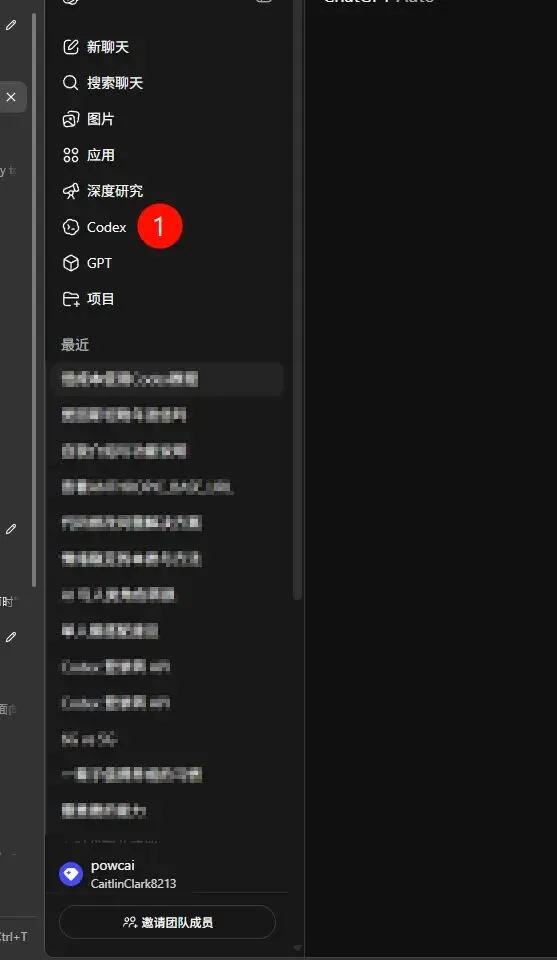

前面苏米分享过一篇文章里提到过低门槛的 AI 编程资源,最大的好处是可以自定义接入方式、对接国内常见应用,还能玩出不少工作流和插件的花活。最近我又折腾出一套更低成本的玩法:用每月大约 6 元的成本,让 Codex、Claude Code、OpenClaw 这类工具跑起来,而且可以搭一个可复用的“代码助理机器人”。对独立开发者来说,这套方案非常适合“低成本试水 + 快速上手”。

核心观点:用 CLI + 本地代理,换一种姿势用上 AI 编程工具

很多人以为要用 Codex、Claude Code、Cherry Studio 这些 AI 编程工具,必须开官方 API,成本随便就是几十到几百。其实并非如此。核心思路是:

拼车账号 → Codex CLI → 本地代理(codex-proxy) → API → 接入客户端

换句话说,把“只能命令行用”的能力,用本地代理包装成标准 API,然后丢给 Cherry Studio、Claude Code、OpenClaw 这些客户端。流程稳定、配置不复杂,小白也能跟着做。

整体准备与风险提示

- 场景定位:低成本体验、个人开发机上跑、非生产用途。

- 账号策略:强烈建议用小号,不要用主号;拼车属于灰度玩法,存在被封、额度变化等风险。

- 法务与合规:遵守平台 ToS,不做二次转售/共享,不用于敏感业务。

一、先买一个 business 拼车(务必用小号)

去闲鱼搜索“business 拼车”,找靠谱卖家购买一个拼车位。

通常卖家会把额度充值到你的账号里(注意,是你自己的账号,后续要用 CLI)。强烈建议:

- 全程使用小号;

- 不要复用主号的密码、邮箱;

- 不要在拼车账号上绑定其他重要服务。

拿到账号后,先确认两件事:

- 网页版能正常登录、能正常对话;

- 账户里能看到一定用量或用量记录。

这一步的意义在于验证“账号权限没问题”,否则后面 CLI 和代理都会白忙活。

二、确认网页版可用,再折腾 CLI

别着急下一步,先在网页上跑两轮对话,确认:

- 登录正常(无异常验证/封禁提示);

- 对话可用(不是提示额度为 0 或受限)。

网页版无误后,再继续 CLI 与代理。

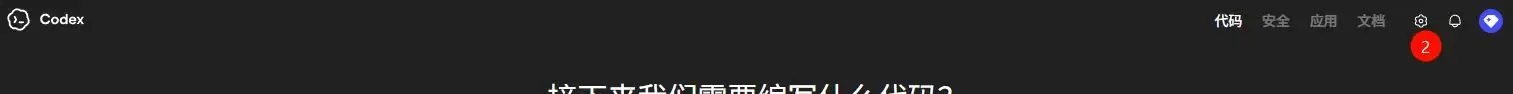

三、准备关键工具:codex-proxy(把 CLI 包成 API)

仓库地址:https://github.com/icebear0828/codex-proxy

作用:将 Codex CLI 的本地能力暴露为标准 API(兼容 OpenAI/Claude 风格)。

这很关键,因为:

- Cherry Studio、Claude Code、OpenClaw 等工具普遍需要填写 API URL / API Key / Model;

- codex-proxy 就是把 CLI 包装成这套通用接口。

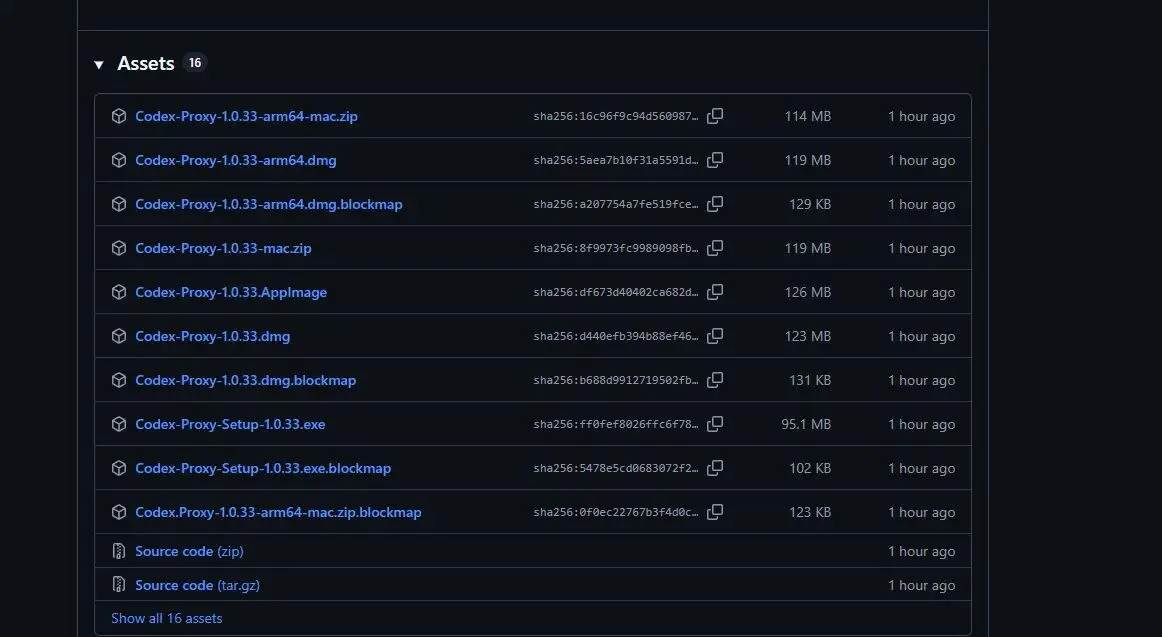

四、下载对应系统版本

在 GitHub Release 页面下载你系统对应的版本:

- Windows 下就下 Windows 版;

- Mac 下就下 macOS 版;

- Linux 下就下 Linux 版。

下载后解压即可。按项目 README 指引完成基本配置(例如端口、模型映射等)。

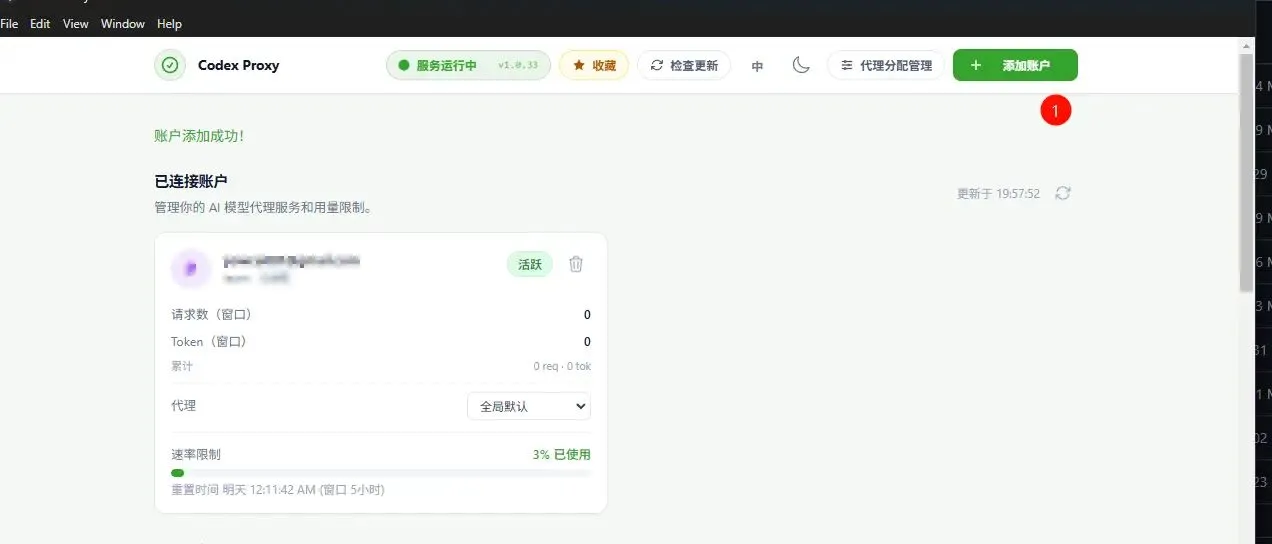

五、启动本地代理并自测

运行 codex-proxy 后,会在本地起一个 API 服务(例如 http://127.0.0.1:port,具体以 README 为准)。

从结构上看,变成:

Codex CLI

↓

codex-proxy(本地 API 服务)

↓

标准 API(OpenAI/Claude 风格)

建议用 curl/FastAPI 文档页做个健康检查:

# 以 OpenAI 风格的模型列表为例(端口与路径以项目 README 为准)

curl -H "Authorization: Bearer test_key" \

http://127.0.0.1:PORT/v1/models

# 简单的对话测试

curl -X POST http://127.0.0.1:PORT/v1/chat/completions \

-H "Authorization: Bearer test_key" \

-H "Content-Type: application/json" \

-d '{

"model": "codex-coder",

"messages": [{"role":"user","content":"hello"}],

"stream": false

}'

返回能拿到 JSON,说明代理 OK。

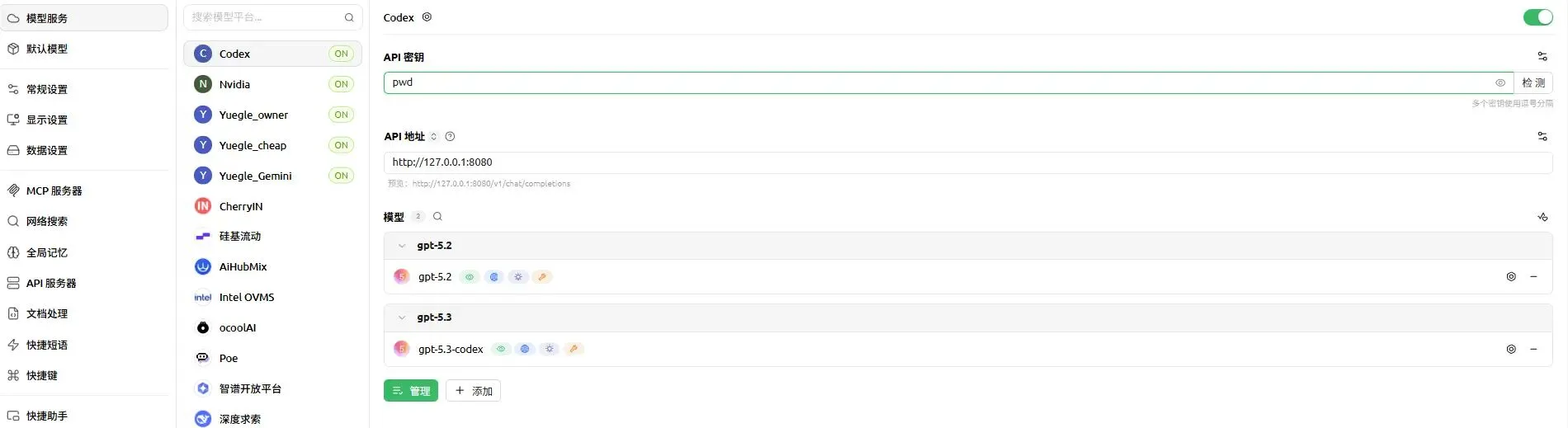

六、接入 Cherry Studio(最友好)

在 Cherry Studio 新建一个 API Provider,填写:

Base URL:你的 codex-proxy 本地地址,例如 http://127.0.0.1:PORT;

API Key:可随便填一个字符串(代理侧只要校验通过即可);

Model:代理支持的模型名(在 /v1/models 能看到)。

保存后即可像调用 OpenAI 一样使用,但底层实际上走的是 Codex CLI → 本地代理。

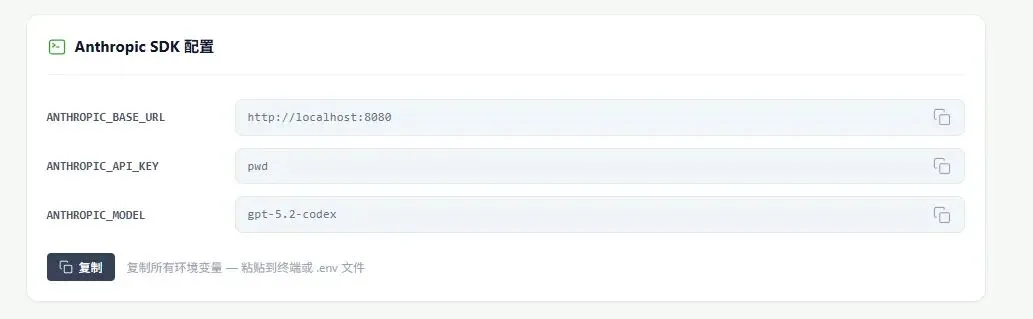

七、接入 Claude Code(兼容模式)

Claude Code 支持 OpenAI/Claude 兼容接口。

只要 codex-proxy 提供兼容端点,配置方式与 Cherry 大致相同:

- Base URL 填本地地址;

- API Key 填任意字符串;

- 选择/填写模型名;

- 导入/启用对应命令后即可在编辑器内直接调用。

八、接入 OpenClaw(同理)

OpenClaw 也是标准 API 客户端。配置与上面完全一致:

- Base URL → 本地 codex-proxy 地址;

- API Key → 任意字符串;

- Model → 代理端可用模型名。

整体调用链路:

OpenClaw → API → codex-proxy → Codex CLI

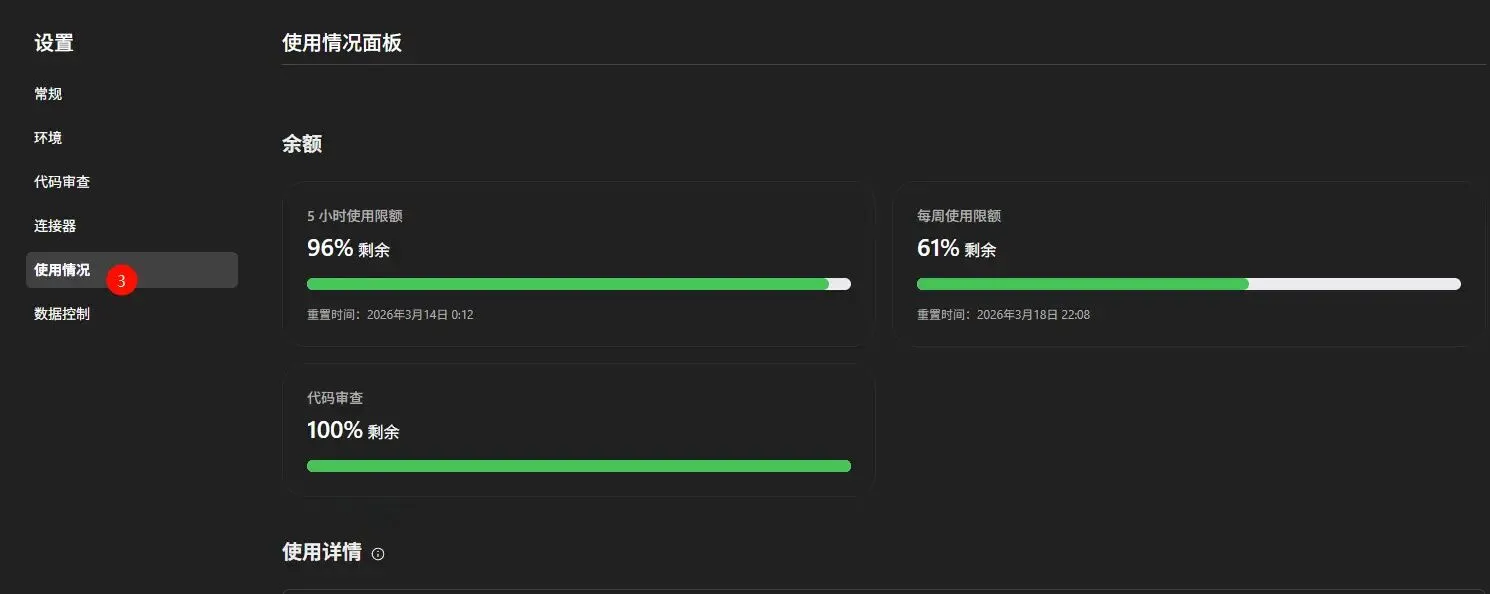

九、为什么成本能做到 6 元/月?

本质是“换了计费入口”:不是直连官方 API,而是用拼车账号跑 CLI,再由本地代理转 API 给前端客户端。所以整体只承担拼车成本(示例中约 6 元/月),而不是按 API Token 计费。注意这也意味着:

- 稳定性受拼车和 CLI/代理影响;

- 有被风控、封号、额度缩水的可能;

- 不适合重要生产环境。

十、手把手搭一个“代码助理机器人”(含工作流思路)

单纯能用起来还不够,我更建议你把它做成“工作流”,形成可复用的“代码助理机器人”。下面给一个轻量级方案,跑在 Cherry Studio 或本地脚本里都行。

目标

输入一个需求描述(或错误日志),机器人自动产出:代码片段、单测样例、修复建议和提交信息。

步骤

- 需求解析节点(LLM)

- 输入:用户描述/Issue 内容;

- 提示词要点:明确目标语言/框架、约束(性能、可维护性)、输出为计划清单。

- 代码生成节点(LLM)

- 输入:步骤 1 的计划;

- 提示词要点:输出完整函数/类,包含必要注释、异常处理,附上最小可运行示例。

- 本地测试节点(Shell 插件/脚本)

- 执行命令:例如

pnpm test/pytest; - 采集:控制台输出/失败栈信息(限制在 N 行内)。

- 执行命令:例如

- 错误修复节点(LLM)

- 输入:失败日志 + 当前代码;

- 提示词要点:给出最小改动的 diff(统一

git diff格式),解释原因。

- 提交信息节点(LLM)

- 输入:改动 diff;

- 输出:规范化提交信息(例如 Conventional Commits)。

如果用 Cherry Studio 的“工作流”功能,可以把 1、2、4、5 设为 LLM 节点(指向你的 codex-proxy Provider),第 3 步用“本地命令”插件或自定义脚本节点。这样,你的“代码助理机器人”就具备了从需求到修复的闭环能力。

参考提示词片段(可直接用)

[需求解析]

你是一名资深{语言/框架}工程师。请把下面的需求拆解为步骤,并指出关键边界条件和潜在风险。

输出 JSON:

{

"goal": "...",

"steps": ["..."],

"constraints": ["..."],

"tests": ["..."]

}

[代码生成]

根据上一步的 steps 与 constraints,产出最小可运行的实现:

- 给出完整代码(含必要注释)

- 添加一个最小可运行示例或单测草案

- 标注所有外部依赖与版本

[错误修复]

根据以下报错与现有代码,生成最小修改的 git diff,并说明原因与影响。

仅输出 diff,不要其他无关文本。

十一、实战经验与排错建议(独立开发者向)

- 端口与防火墙

- 优先绑定

127.0.0.1(避免局域网暴露); - Windows 记得允许访问,或手动添加放行规则。

- 优先绑定

- 模型与功能

- 不同代理实现的功能覆盖不同:流式输出、工具调用、函数调用未必全支持;

- 先用最基本的

/v1/chat/completions标准流打通再进阶。

- 长上下文与限速

- 拼接大文件前先做“摘要 + 分块”策略;

- 并发高时在客户端做限流(如 2–3 并发)。

- 稳定运行

- Linux/macOS 用

systemd、pm2托管代理进程; - 把“启动代理 → 健康检查 → 启动客户端”的顺序写到启动脚本里。

- Linux/macOS 用

- 备选方案

- 本地模型兜底:如 Ollama + 轻量模型,用于离线或临时不可用时的降级;

- 关键任务单独再跑一份“官方 API 通道”,确保结果可对照与稳定性。

最后的风险提醒

- 拼车可能存在:账号被封、拼车失效、额度变化等情况;

- 务必使用小号,避免主号受影响;

- 不要把这套方案用在生产或对可靠性要求极高的业务上。

总结:低成本试水 AI 编程,这条路可走,但要有“工程化思维”

整套流程就是一句话:买拼车 → 用 Codex CLI → 用 codex-proxy 转 API → 接入 Cherry/Claude Code/OpenClaw → 做成一个可复用的“代码助理机器人”工作流。对于像我这样的独立开发者,省钱很重要,但更重要的是把工具变成“可复制、可维护、可扩展”的工程化能力。6 元/月就能把整套 AI 编程流程跑起来,值得一试;用得顺手,再考虑升级到更稳的官方通道,这样心里更有数。